개인정보보호, 소프트웨어 정책

설명을 요구할 권리(right to explanation)

‘설명을 요구할 권리(right to explanation)’는 정보 주체인 사용자가 알고리즘이 내리는 자동화된 의사결정에 대해서 알고리즘의 공정성과 객관성에 의문을 가질 때 설명을 요구할 권리가 보장된다면 기업과 공공기관 등에 알고리즘 작동 원리에 대해 설명을 요구할 수 있는 권리다.

왜 설명을 요구할 권리가 필요한가?

설명을 요구할 권리에 대한 논의는 2016년 유럽에서 시작됐다. 그 배경에는 ‘알고리즘은 객관적’이라는 믿음에 반해 지속해서 발생하는 알고리즘의 사회적 역기능과 부작용이 나타났기 때문있다.

알고리즘이 겉보기에 객관적인 처리 방식으로 객관적이고 중립적이라 공정한 것 같다고 인식되며, 우리의 행동에 스며드는 식으로 작동하기 때문에 그 영향을 쉽게 인지하기 어렵다. 그러나 이런 믿음이 사실이 아니라는 사례가 잇달아 발생했다. 의도적이든 의도적이지 않든, 알고리즘이 편향적이거나 차별적인 의사결정을 내놓는 사례들이 나타나고 있다.

2015년 연구 결과에 따르면 구글의 온라인 광고 알고리즘은 성차별적이고 인종차별적으로 작동했다. 구글 온라인 광고는 여성보다 남성에게 상대적으로 임금이 높은 직업 광고를 추천하는 경향이 있고, 백인보다 흑인에게 저렴한 상품 광고를 집중적으로 보여주는 경향이 높았다.

2016년 7월 ‘전 세계 최초로 인공지능(AI)이 심사하는 미인대회’라는 슬로건을 내걸고 열린 온라인 국제미인대회에서도 비슷한 일이 일어났다. 대회 참가자들의 프로필 사진 심사를 맡은 인공지능 프로그램 ‘뷰티닷에이아이(Beauty.AI)’는 백인 여성만 대회에 입선시켰다.

또 지난 2016년 5월 미국 대선을 5개월 앞둔 시점에 미국 IT 매체 <기즈모도>는 페이스북이 특정 미국 대선후보를 낙선시키기 위해 페이스북 내 뉴스편집 서비스 인 ‘트렌딩 토픽’의 알고리즘을 조작했다는 의혹 보도가 나오기도 하였다.

우리나라에서도 네이버의 실시간 검색어 조작 등으로 포털의 검색 서비스의 실시간 급상승 검색어, 자동완성, 연관검색어 등의 적정성 및 공정성에 대하여 이슈를 발생하고 있다.

오늘날 일상생활 곳곳에 관여하는 알고리즘이 이같이 사회적 편견과 차별적인 의사결정을 내리고 있지만, 정보 주체는 알고리즘이 어떻게 작동하는지 알 수 없다. 기업 등 알고리즘을 사용하는 주체가 알고리즘의 작동 원리를 투명하게 공개하지 않기 때문이다.

오늘날 일상생활 곳곳에 관여하는 알고리즘이 이같이 사회적 편견과 차별적인 의사결정을 내리고 있지만, 정보 주체는 알고리즘이 어떻게 작동하는지 알 수 없다. 기업 등 알고리즘을 사용하는 주체가 알고리즘의 작동 원리를 투명하게 공개하지 않기 때문이다.

알고리즘 규제의 전환점으로 평가받는 EU의 일반 데이터 보호 규정(GDPR) 중 ‘설명을 요구할 권리’를 중심으로 아래와 같은 알고리즘 규제 이슈를 보이고 있다.

– 알고리즘이 내리는 자동화된 의사결정에는 우선순위 결정, 분류, 관련짓기, 필터링이라는 과정이 존재하는데, 이 과정이 인간 개입에 따른 오류와 편향성, 검열의 가능성 등 본질적으로 차별적인 성격을 내포하기 때문임

– 알고리즘은 정의된 명령에 따라서만 작동하는 것이 아니라 이용하는 사람 혹은 객체와의 상호작용 속에서 끊임없이 수정 및 조정되므로 인간의 편견이나 선입견이 반영될 가능성 상존

– 특히, 알고리즘은 과거로부터 쌓여온 데이터를 학습하면서 인종차별, 성차별 등 역사적 편향성을 반영할 가능성도 매우 높음

알고리즘은 우리가 자주 접하는 여론조사 결과의 신뢰성에 대한 불신 원인과 같이 “알고리즘은 관계자의 성향과 판단, 사회적 풍토, 외적인 압력이 개입될 수 있기 때문에 알고리즘은 편향적으로 수행될 수 있어, 기술적이든 제도적이든 알고리즘의 책임성, 공정성, 투명성을 제고하기 위한 노력이 요구된다”

알고리즘 규제 이슈 담은 EU의 ‘일반개인정보보호규정’

알고리즘의 사회적 부작용과 역기능이 불거진 가운데 2016년 4월, 유럽연합(EU)에서 ‘일반개인정보보호규정(GDPR : General Data Protection Regulation)’이 통과됐다. GDPR은 알고리즘 규제에 대한 법제화를 주요 내용으로 다루고 있어, 인공지능 시대 알고리즘 규제에 대한 중요한 전환점으로 평가받는다. 유럽에서 GDPR가 통과된 것은 설명을 요구할 권리에 대한 논의가 본격적으로 시작된 사건이다. GDPR의 효력은 2018년 5월부터 유럽 전역에서 발효된다.

GDPR 발효일까지 남은 기간을 알려주는 EU GDPR 홈페이지

GDPR는 1995년에 제정된 EU의 데이터 보호 지침에서 한 단계 더 나아갔다. ‘지침’과 달리 ‘규정’이 되면 회원국 차원의 입법 절차 없이 즉시 법으로서의 효력이 발휘된다. 디지털 기술이 일상에 미치는 영향력이 늘어남에 따라 개인정보를 보호하기 위해 제정됐다. 개인정보보호에 대한 책임성을 대폭 강화한 것이 특징이다.

GDPR의 13~15조 ‘설명을 요구할 권리’

GDPR의 13~15조 ‘설명을 요구할 권리’

이번에 특히 강조되는 것은 ‘설명을 요구할 권리’다. ‘설명을 요구할 권리’는 직접 명시된 권리는 아니다. 옥스퍼드대의 굿맨과 플랙스먼이 자신들의 논문에서 GDPR의 13~15조를 해석하면서 유명해진 개념이다. 보고서에서 설명한 ‘설명을 요구할 권리’를 요약하면 다음과 같다.

– 알고리즘에 의해 행해진 결정에 대해 질문하고 반박할 수 있다.

– 데이터를 다루는 사람은 개인에게 언제, 왜 데이터를 모으고 처리하는지 알려야 한다.

– 개인의 권리행사를 위해 투명하게 공개된 정보, 쉬운 의사소통 요구.

다만 ‘설명을 요구할 권리’를 둘러싸고는 다소간의 논란이 있다. 긍정하는 측은 알고리즘의 공정성 이슈를 해결하는 데 사용자의 통제 가능성이 생겼다는 것에 주목한다. 우려하는 측은 규제가 유용한 혁신을 저해할 가능성을 생각한다. 이 외에 심층신경망 같은 불투명하고 복잡한 알고리즘에는 누가 참여하는지 알 수 없어 규제가 어렵다는 견해, 인간을 간접적 우회적으로 통제 과정에 포함해 규제를 우회할 수 있다는 입장도 제기된다.

♦ 설명을 요구할 권리는 혁신의 걸림돌

설명을 요구할 권리를 보장한 GDPR의 알고리즘 규제를 ‘불필요한’ 규제로 보는 시각이 많다. 기술 발전과 기업 혁신을 저해한다는 이유에서다.

GDPR이 통과됐다는 소식을 접한 많은 기업들은 알고리즘 규제가 정보 주체인 소비자에게 기여하는 바는 적은 반면, 인공지능 기술이 발전하는 속도는 크게 떨어뜨릴 것이라고 우려했다.

기업이 알고리즘을 통해 공정치 않은 결정을 내릴 가능성에 대처하기 위해 GDPR이 고안됐다는 점을 이해하지만, 이미 기존 법 · 제도에 개인이 기업에 맞서 자신의 이익을 지킬 수 있는 조항이 있기 때문에 GDPR의 실효성에 의구심이 든다는 것이다. 이들은 또 개발자들이 GDPR 기준을 따르다가 유럽의 인공지능 발전이 뒤처질 것이라고 우려한다.

그 이유로 다음과 같은 점을 제시하고 있다

› ‘블랙박스’ 존재하는 알고리즘

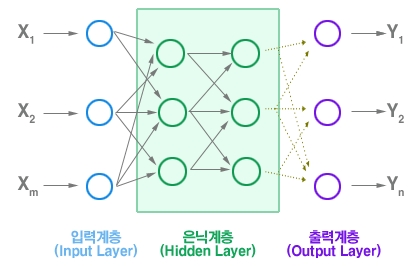

설명을 요구할 권리를 보장하는 것이 ‘불가능’하다며 GDPR을 비판하는 목소리도 있다. 알고리즘은 머신러닝 등 기술의 발전으로 점점 고도화됐다. 이에 따라 알고리즘을 설계한 개발자조차 자신이 만든 알고리즘이 어떻게 결과를 도출하는지 완벽하게 이해하지 못한다. 즉 알고리즘에는 그 누구도 이해할 수 없는 영역인 ‘블랙박스’가 존재하는 알고리즘도 있다는 점이다.

알고리즘에는 누구도 이해 못하는 영역인 ‘블랙박스’가 존재.

알고리즘에는 누구도 이해 못하는 영역인 ‘블랙박스’가 존재.

IT 매체 <와이어드>는 “신경망 네트워크처럼 설계된 알고리즘 내부에서 무슨 일이 일어나고 있는지 설명하는 것은 전문가들에게도 벅찬 일”이라고 짚으며 “알고리즘이 정확히 어떤 과정을 거쳐 특정 결정을 도출했는지 추적하기란 불가능하다”라고 지적했다.

신경망 알고리즘 구조도

이에 대해 GDPR의 초안을 작성하는 데 참여했던 빅토르 마이어 쇤베르거(Viktor Mayer-Schonberger) 영국 옥스퍼드대 교수는 “알고리즘의 자동화 의사결정에 대한 GDPR 조항은 여러 해석에 대해 열려 있다”라고 말했다. 여러 이해관계자들이 사회적 논의를 거쳐 합의를 도출해야 할 영역이라는 것이다.

GDPR 초안 작성에 참여한 빅토르 마이어 쇤베르거 영국 옥스퍼드대 교수.쇤베르거 교수는 빅데이터 분야 세계 최고 권위자로, <빅데이터가 만드는 세상>(Big Data: A Revo-lution That Will Transform How We Live, Work and Think), <잊혀질 권리>(Delete: The Virtue of Forgetting in the Digital Age) 등의 저자이기도 하다.

브라이스 굿맨과 세스 플랙스먼 역시 보고서에서 “현재 머신러닝 프로그램에 대해 GDPR는 여러 가지 문제점을 안고 있다”라며 “이런 문제들은 좋은 과제가 될 수 있다”라고 말했다. 그러면서 “알고리즘의 효율성 뿐만 아니라, 투명성과 공정성 역시 중요하다”라고 강조했다.

참고문헌

- Bryce Goodman·Seth Flaxman, 『European Union regulations on algorithmic decision-making and a “right to explanation”』, (Oxford Internet Institute, 2016.8.31)

- Michael Nunez, 『Former Facebook Workers: We Routinely Suppressed Con-servative News』, (Gizmodo, 2016.5.9)

- 이원태, 『EU의 알고리즘 규제 이슈와 정책적 시사점』, (KISDI, 2016.12.26)

- 채반석, 『“내가 클릭한 이유를 알려줘”…EU의 ‘설명을 요구할 권리’란?』, (블로터, 2016.12.27)

- Cade Metz, 『Artificial Inteligences Is Setting up the Internet for a Huge Clash with Europe』, (Wired, 2016.7.16)

- Nick Wallace, 『EU’s Right to Explanation: A Harmful Restriction on Artificial Intelligence』, (Techzone360, 2017.1.25)

- 한수연, 『“설명을 요구할 권리’』, (블로터, 2017.5.18)